text2video (StableDiffusion)

はじめに

Stable Diffusion web UI用の拡張機能として、短い動画を自動生成することができます。

text2videoインストール

web UIの拡張機能リストからインストールします。

- web UIの拡張機能タブ→「Extensions」

- text2video Extension→「install」

インストール後、web UIを再起動してください。

ModelScopeの準備

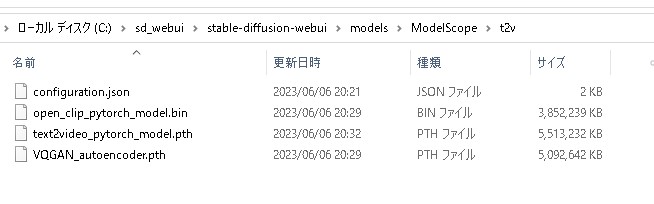

以下の4つのファイルをダウンロードします。

- VQGAN_autoencoder.pth

- configuration.json

- open_clip_pytorch_model.bin

- text2video_pytorch_model.pth

以下のサイトから、ファイルをダウンロードできます。

【公式サイト】

ダウンロードしたファイルは、以下のフォルダに移動します。

※「ModelScope」フォルダ以下は、自分で作成します

webui\models\ModelScope\t2v

VideoCrafterの準備

下記ページからモデル(model.ckpt)をダウンロードします。

【公式サイト】

ダウンロードしたファイルは、以下のフォルダに移動します。

※「VideoCrafter」フォルダ以下は、自分で作成します

webui\models\VideoCrafter

ダウンロードしたファイルは、以下のフォルダに移動します。

※「VideoCrafter」フォルダ以下は、自分で作成します

webui\models\VideoCrafter

【今回のプロンプト:1dog, walking,】

Generateをクリックして、動画を生成します。

生成された動画ファイルは、以下のフォルダに保存されます。

※サブフォルダが作られて、連番の静止画(PNGファイル)と動画ファイル(MP4)が出力されます。

webui\outputs\img2img-images\text2video

作成例

【今回のプロンプト:1dog, walking,】

参考サイト

短い動画を生成できる拡張機能「text2video Extension」の使い方【Stable Diffuison web UI】

考察

短い動画ではあるが、プロンプトによって簡単に作成できた。

プロンプトの入力を工夫すると、何かに使えるかもしれない。