はじめに

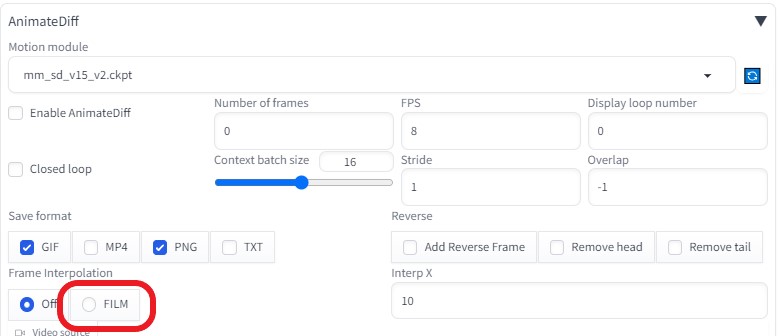

AnimateDiffにあるFILMの項目に興味をもった。

※FILM(Frame Interpolation for Large Motion)

2枚の画像を入力するだけで、その間の動きを補間して、動かすという技術だそうです。

参考サイト

画像をぬるぬる動かすFrame Interpolation for Large Motion【FILM】

画像をぬるぬる動かすFrame Interpolation for Large Motion【FILM】

ディープラーニングの使いどころはたくさんあると思います。今までいろいろなモデルをいじってきた私が考える、ディープラーニングの使い方の真骨頂は「補間」です。今回、試してみるのは"THE補間"ともいえる技術のFrame In

【Paperspace Gradient】FILM(Frame Interpolation for Large Motion)で動画の補間をしてみた

【Paperspace Gradient】FILM(Frame Interpolation for Large Motion)で動画の補間をしてみた

はじめに先日の記事『【Paperspace Gradient】Text2Video-ZeroとAnything v4.0を用いて,テキストからアニメ動画を生成してみた』ではText2Videoで動画の生成を行った.そこで得られた動画をFIL

FILMインストール

Windows インストール手順

frame-interpolation/WINDOWS_INSTALLATION.md at main · google-research/frame-interpolation

FILM: Frame Interpolation for Large Motion, In ECCV 2022. - google-research/frame-interpolation

github

GitHub - google-research/frame-interpolation: FILM: Frame Interpolation for Large Motion, In ECCV 2022.

FILM: Frame Interpolation for Large Motion, In ECCV 2022. - google-research/frame-interpolation

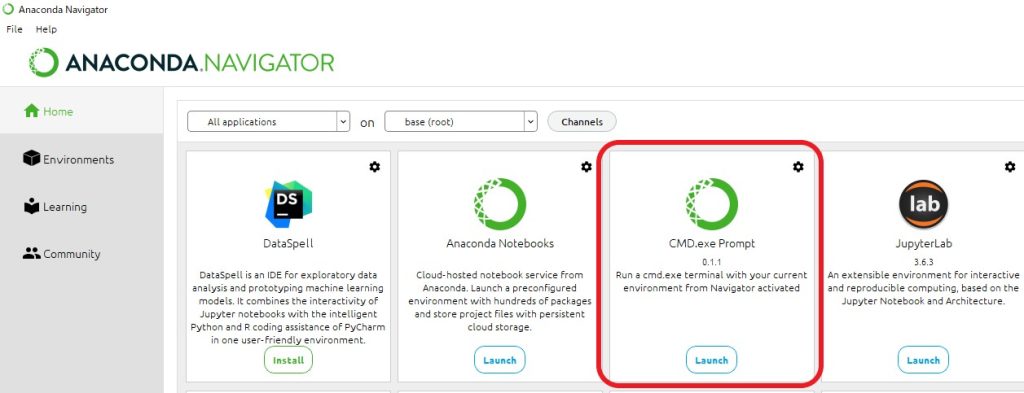

Anaconda

- Anacondaをインストール

- CMD.exe PromptのLaunchから起動

pip install --ignore-installed --upgrade tensorflow==2.6.0

python -c "import tensorflow as tf;print(tf.reduce_sum(tf.random.normal([1000, 1000])))"frame-interpolation>に「pretrained_models」フォルダを作成し、以下のデータをインストールする

pretrained_models - Google ドライブ

git clone https://github.com/google-research/frame-interpolation

cd frame-interpolation

pip install -r requirements.txt

conda install -c conda-forge ffmpeg

FILM実行

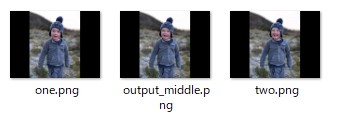

中間フレーム補間

python -m eval.interpolator_test --frame1 photos\one.png --frame2 photos\two.png --model_path <pretrained_models>\film_net\Style\saved_model --output_frame photos\output_middle.png

多数のフレーム間補間

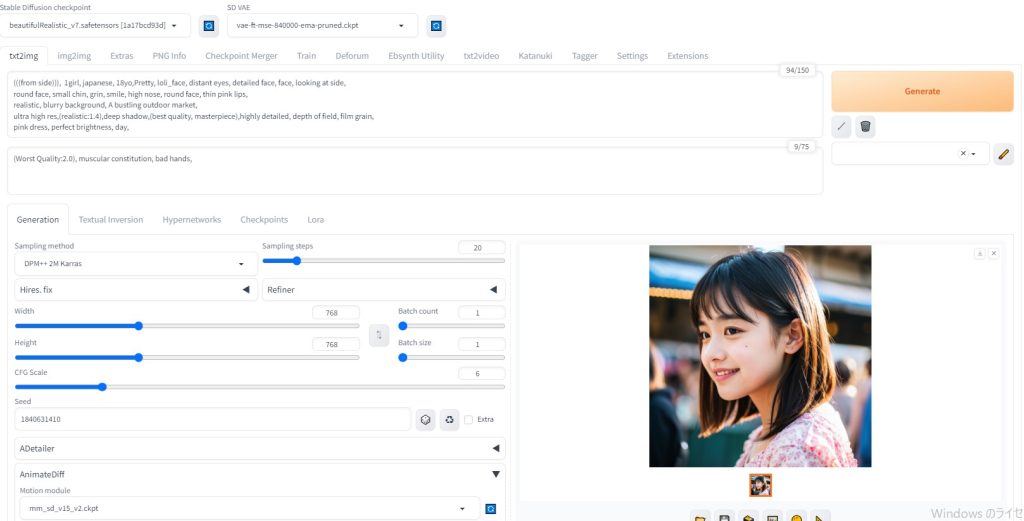

AI画像を生成

同様な画像を少しずつ変化を加えて5枚生成し、4枚を逆順に加える。

※生成画像01.png~05.png、逆順で06.png~09.pngを作成する

画像01.png~09.pngを「photos」フォルダ以下に配置

python -m eval.interpolator_cli --pattern "photos" --model_path <pretrained_models>\film_net\Style\saved_model --times_to_interpolate 6 --output_video

完成動画

※interpolated.mp4

FILM引数

--pattern : 画像の保存してあるパス。複数枚画像がある場合はそれぞれについて補間する。 --model_path : 学習済みの重みデータのパス。 --times_to_interpolate : 2枚の画像をどのくらい補間するか指定。(6に設定した場合 2^6+1=65枚) --output_video : mp4出力する。 --fps : mp4出力する場合のfpsを設定する。 --frame1 : --patternの代わりに使用。入力画像1のパスを指定。 --frame2 : --patternの代わりに使用。入力画像2のパスを指定。

編集動画(BGM付き)

【VideoProc Vlogger 編集画面】

考察

スローで描画しても、かなり綺麗に映っている。

今後、何かに活用していきたい。

おまけ

pretrained_models-20220214T214839Z-001.zip

optobsafetens/inswapper_128 at main

We’re on a journey to advance and democratize artificial intelligence through open source and open science.